ChatGPT来了,百万打工人都慌了......

如果说上个月AIGC的热度还只停留在技术圈,那么近AIGC的影响力已经辐射到普通打工人了!

4月18日,国内办公软件巨头金山正式发布了生成式人工智能应用WPS AI,这也是国内协同办公赛道类ChatGPT式应用,真在线拯救打工人!图:WPS AI功能展示

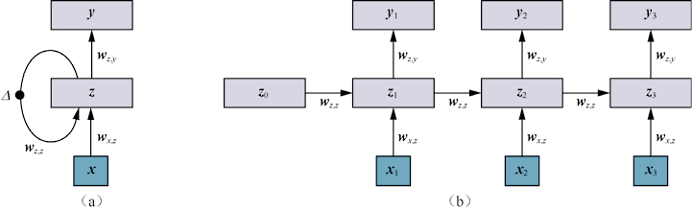

可见,在数字世界和物理世界加速融合的大背景下,AIGC正在悄然引导着一场智能数字化转型,重塑与颠覆内容的生产方式和消费模式,对未来产生革命性影响!那么,就人工智能领域而言,AIGC的崛起意味着什么?它充分证明生成式AI应用正在逐步落地,不再是停留在书本里的幻想。AIGC赋能实现了自然语言与人工智能的融合,这是其核心价值所在,更是人工智能的难点所在。《人工智能:现代方法(第4版)》也提到,自然语言处理(NLP)是人工智能领域为困难的问题之一。因为语言体系本就复杂多变,所以很难用统一、标准的范式来解决自然语言处理问题。就这个问题,本书第24章“自然语言处理中的深度学习”专门用一章的篇幅对其进行了深入阐释。进行自然语言处理时,需要使用循环神经网络(Recurrent Neural Network, RNN)。RNN是一类以序列数据为输入,在序列的演进方向进行递归,且所有节点(循环单元)按链式连接的递归神经网络。本书第21章对其展开了深入讲解,感兴趣的读者可以仔细阅读。图:书中的RNN相关知识

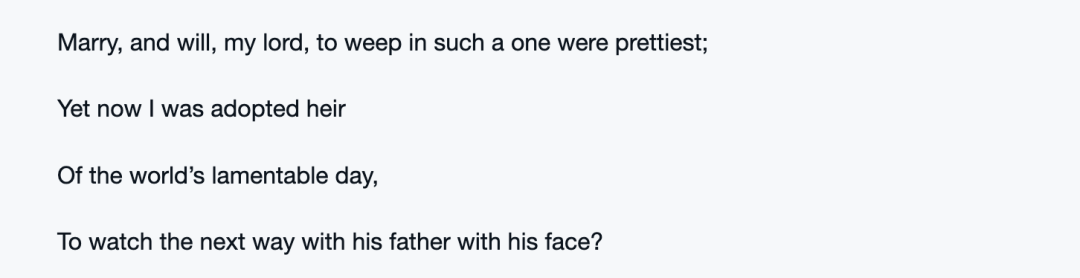

由于RNN旨在处理时间序列数据,因此用RNN一次可以处理一个单词。在RNN语言模型中,每个输入单词都被编码为一个词嵌入向量。使用RNN架构可以解决参数过多(单词数量过多)、不对称(每个单词权重不同)和上下文有限的问题。下图是书中给出的示例,是由莎士比亚的作品训练得到的RNN模型生成的随机文本。图:书中给出的示例截图

从这个案例再到今日AIGC的腾飞,我们可以看到:经过多年发展,人工智能已经演进为一个自然语言处理的超级系统,自然语言与人工智能已经达到了“水乳*交融”的地步。

AIGC之所以能够爆发,核心的因素就是深度学习模型的技术创新。研究发现,当模型和数据集达到一定规模时,继续扩大模型和数据集,给卷积神经网络带来的收益有限。Transformer架构的出现如同及时雨一般,让自然语言处理更上一层楼。《人工智能:现代方法(第4版)》中专门对Transformer架构进行了深入介绍。其实,Transformer 架构被引入之前,AIGC大都是基于序列到序列模型(sequence-to-sequence model)的。该模型由两个 RNN 网络组成,个 RNN 是编码器,第二个 RNN 是解码器。然而,序列到序列模型具有一定局限性,会导致计算结果不够理想。Transformer 架构打破了这种局限性,它对自注意力机制进行了扩展,让每个隐藏状态序列同样关注自身,从源到源,从目标到目标。这使得模型可以额外捕获每个序列中的长距离上下文。图:书中对Transformer的讲解

“Transformer架构使用了一种自注意力机制,该机制可以在没有顺序依赖的情况下对长距离上下文进行建模。”——本书作者Transformer融入了注意力机制和神经网络模型领域的主流模型和关键技术,通过计算数据之间的关系来提取信息,能够捕获复杂的特征表示,提高了训练效率,因此更适合参数和数据集庞大的自然语言处理。图:书中对Transformer的讲解

随着AI模型的参数量及数据集不断增大,Transformer已然成为适合大模型的架构,AIGC也因此迎来了自己的春天。

对AIGC感兴趣的读者完全可以通过本书get更多Transformer干货知识!ChatGPT的出现让我们看到了机器的智能水平,但也引发了一轮冲击。AIGC让内容创作的边际成本逼近于零,自然智能所独有的写作、绘画、音乐、教育等创造性工作受到威胁。AIGC正在向人类社会提出挑战:AI的智慧程度会不会超过人类?这种智能是人类需要的吗?科技发展是否会突破伦理限制?……翻开《人工智能:现代方法(第4版)》的第27章“人工智能的哲学、伦理和安全性”,或许你会找到答案:人工智能固然拥有智慧,但聪明过头或许会引起一系列隐私泄露和伦理问题。图:本书作者Peter Norvig

另外,小异特意精选了几个大家感兴趣的问题,让我们一起看看作者持怎样的观点——

▮ 机器需要学会真正的思考吗?

作者并不想让机器拥有和人类一模一样的意识,机器只需要具备一定程度的认知即可。意识的各个方面,认知、自我认知、注意力等都可以通过编程成为智能机器的一部分。 ▮ 机器产生偏见怎么办?

机器学习模型会延续社会偏见,因为它会从训练集的样本中学会人类的种族或性别偏见。为了防止偏见,书中提出了采用对数据集和模型附带标注、去除数据偏差以及发明更有抵抗力的模型和算法这3种想法。 ▮ 机器人需要有人格吗?

机器人是人类创造出来用于完成指令的工具。如果授予其人格,可能只是在拒自身的行为负责。此外,计算概念的加入可能会模糊人和机器之间的界限。

当然,除了对机器进行约束,更重要的是人类的道德规范。作者认为,人工智能构成了潜在危险,从事人工智能技术研究的人在道德上有责任来降低这些危险。

图:斯图尔特·罗素教授发表演讲

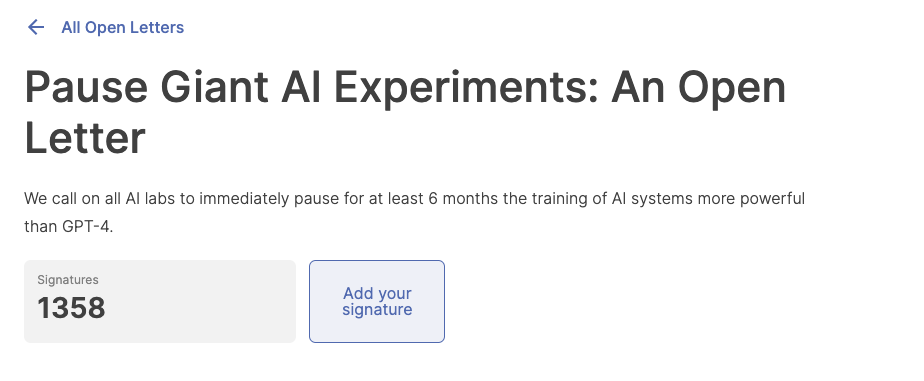

4月5日,斯图尔特·罗素教授在加州大学伯克利分校发表了演讲。他表示:AI 应该被设计为有益人类的样子,因此需要重新思考强化学习和监督学习等概念,并且敦促各国监控 AI 以确保它能保证人类的利益。此外,他还和1000位科技大佬与AI专家共同签署了公开信,呼吁所有 AI 实验室立即暂停对比GPT-4 更强大的AI系统的训练至少6个月。图:作者签署的公开信

他的观点与行为都印证了书中的观点:未来不是机器注定的,而是人类创造的。事实上,AIGC的影响远不止于AI领域本身,它对人类社会的方方面面都产生了深刻影响,因为人工智能本就是一门复杂的交叉学科,囊括了哲学、数学、计算机科学、语言学、伦理学等诸多学科的知识。